Индивидуалните въведени данни се съхраняват под формата на „ Тензори ” в PyTorch и „ градиенти ” на тензорите се изчисляват с помощта на обратно разпространение в рамките на тренировъчния цикъл на модел за дълбоко обучение. Терминът „ немащабиран ” означава, че данните са необработени и няма предварителна обработка или оптимизация. Немащабираният градиент на тензор предоставя истинската стойност на промяната относно определената функция на загуба.

В този блог ще обсъдим как да изчислим немащабирания градиент на тензор в PyTorch.

Какво е немащабиран градиент на тензор в PyTorch?

Тензорите са многоизмерни масиви, които съдържат данни и могат да работят на GPU в PyTorch. Тензорите, които съдържат необработени данни от набора от данни без предварителна обработка, трансформации или оптимизации, се наричат немащабирани тензори. Въпреки това, един „ Немащабиран градиент ” е различен от немащабиран тензор и трябва да се внимава да не се объркат двете. Немащабиран градиент на тензор се изчислява по отношение на избраната функция на загубите и няма допълнителни оптимизации или мащабиране.

Как да изчислим немащабирания градиент на тензор в PyTorch?

Немащабираният градиент на тензор е действителната стойност на скоростта на промяна на входните данни относно избраната функция на загуба. Необработените данни за градиента са важни за разбиране на поведението на модела и неговата прогресия по време на обучителния цикъл.

Следвайте стъпките, дадени по-долу, за да научите как да изчислявате немащабирания градиент на тензор в PyTorch:

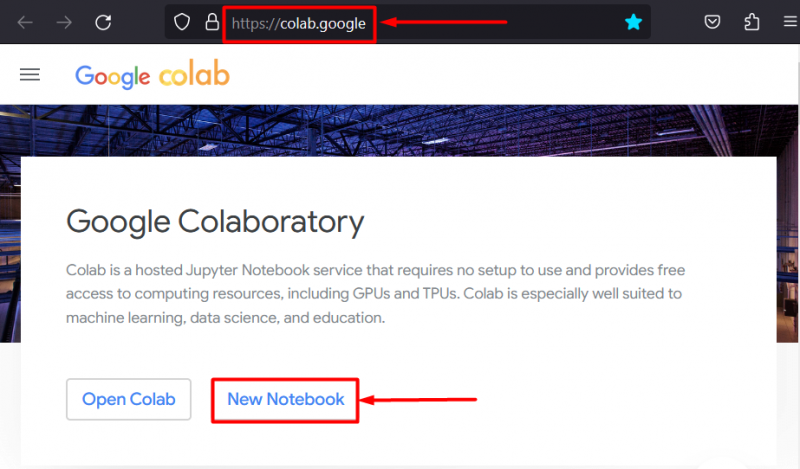

Стъпка 1: Започнете проекта, като настроите IDE

Google Collaboratory IDE е един от най-добрите избори за разработване на проекти на PyTorch, защото предоставя безплатен достъп до GPU за по-бърза обработка. Отидете в Colab уебсайт и щракнете върху „ Нов бележник ” опция за започване на работа:

Стъпка 2: Импортирайте Essential Torch Library

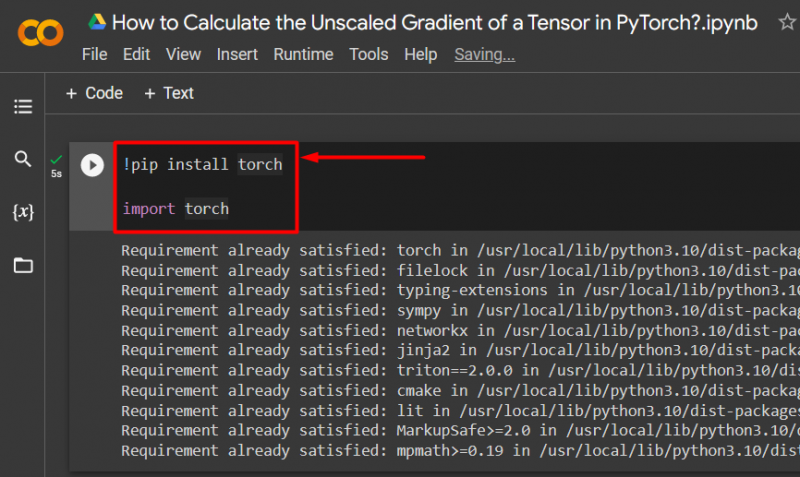

Цялата функционалност на рамката на PyTorch се съдържа в „ Факел ' библиотека. Всеки проект на PyTorch започва с инсталиране и импортиране на тази библиотека:

!pip инсталирайте горелкафакел за внос

Горният код работи по следния начин:

- “! пип ” е инсталационен пакет за Python, използван за инсталиране на библиотеки в проекти.

- „ импортиране ” се използва за извикване на инсталираните библиотеки в проекта.

- Този проект се нуждае само от функционалността на „ факла ' библиотека:

Стъпка 3: Дефинирайте тензор на PyTorch с градиент

Използвай ' факла.тензор ()” метод за дефиниране на тензор с градиент “ requires_grad=Вярно ” метод:

A = torch.tensor([5.0], requires_grad=True)Стъпка 4: Дефинирайте проста функция за загуба

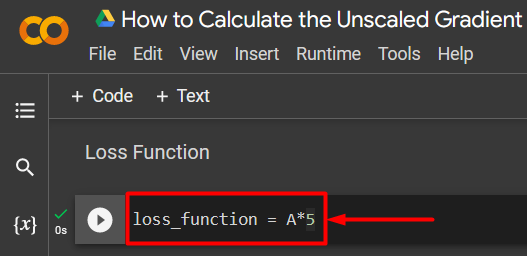

Функция на загуба се дефинира с помощта на просто аритметично уравнение, както е показано:

загуба_функция = A*5

Стъпка 5: Изчислете градиента и отпечатайте за изход

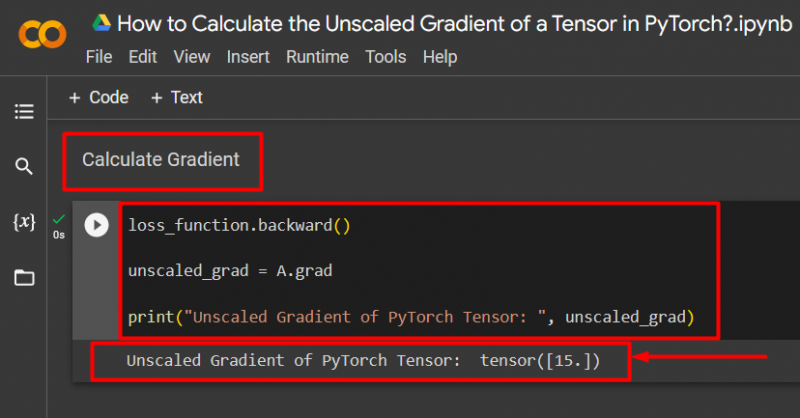

Използвай ' назад ()” за изчисляване на немащабирания градиент, както е показано:

загуба_функция.назад()unscaled_grad = A.grad

print('Немащабиран градиент на PyTorch Tensor: ', unscaled_grad)

Горният код работи по следния начин:

- Използвай ' назад ()” метод за изчисляване на немащабирания градиент чрез обратно разпространение.

- Задайте „ А.град ' към ' немащабиран_град ” променлива.

- Накрая използвайте „ печат ()” метод за демонстриране на резултата от немащабирания градиент:

Забележка : Можете да получите достъп до нашия бележник Colab тук връзка .

Професионален съвет

Немащабираният градиент на тензорите може да покаже точната връзка на входните данни с функцията на загубата за невронна мрежа в рамките на PyTorch. Суровият нередактиран градиент показва как двете стойности са свързани систематично.

Успех! Току-що показахме как да изчислим немащабирания градиент на тензор в PyTorch.

Заключение

Изчислете немащабирания градиент на тензор в PyTorch, като първо дефинирате тензора и след това използвате метода backward(), за да намерите градиента. Това показва как моделът на дълбоко обучение свързва входните данни с дефинираната функция на загуба. В този блог сме дали поетапен урок за това как да изчислим немащабирания градиент на тензор в PyTorch.