LangChain е рамката с приложението в домейна за обработка на естествен език или NLP за изграждане на модели на човешки езици. Тези модели могат да се използват от хората, за да получават отговори от модела или да водят разговор като всеки друг човек. LangChain се използва за изграждане на вериги, като съхранява всяко изречение в разговора и взаимодейства допълнително, използвайки го като контекст.

Тази публикация ще илюстрира процеса на изграждане на LLM и LLMChain в LangChain.

Как да изградите LLM и LLMChain в LangChain?

За да изградите LLM и LLMChain в LangChain, просто преминете през изброените стъпки:

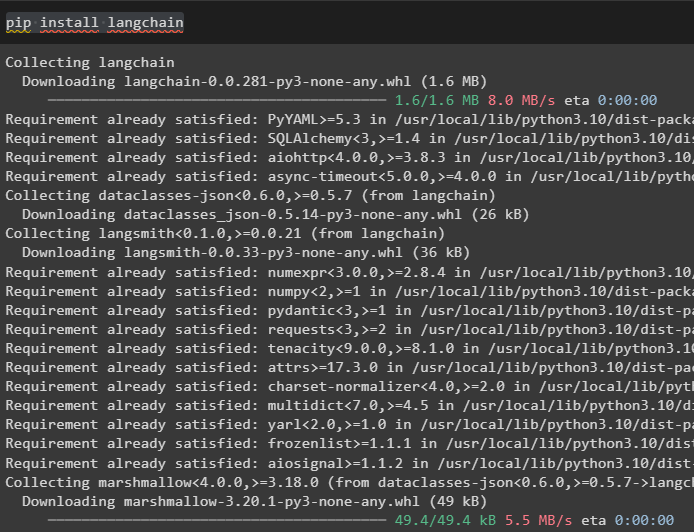

Стъпка 1: Инсталирайте модули

Първо, инсталирайте модула LangChain, за да използвате неговите библиотеки за изграждане на LLM и LLMChain:

pip инсталирайте langchain

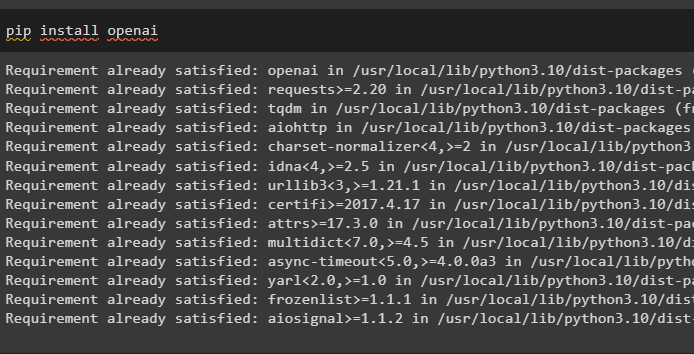

Друг модул, който е необходим за изграждане на LLM, е OpenAI и може да бъде инсталиран с помощта на командата pip:

pip инсталирайте openai

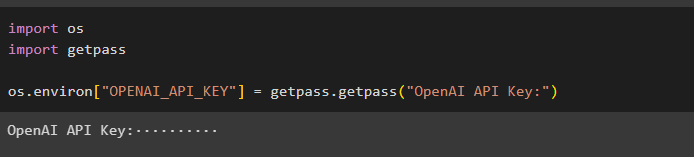

Стъпка 2: Настройте среда

Настройте среда, като използвате OpenAI API ключа от нейната среда:

импортирайте ниimport getpassos.environ['OPENAI_API_KEY'] = getpass.getpass('OpenAI API Key:')

Пример 1: Изграждане на LLM с помощта на LangChain

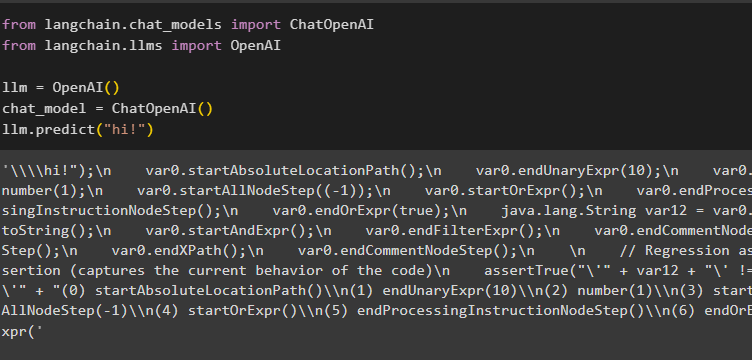

Първият пример е да се изградят големите езикови модели с помощта на LangChain чрез импортиране на OpenAI и ChatOpenAI библиотеки и използване на функцията llm():

Стъпка 1: Използване на LLM Chat Model

Импортирайте модули OpenAI и ChatOpenAI, за да изградите прост LLM, използвайки среда OpenAI от LangChain:

от langchain.chat_models импортирайте ChatOpenAIот langchain.llms импортирайте OpenAI

llm = OpenAI()

chat_model = ChatOpenAI()

llm.predict('здравей!')

Моделът е отговорил с отговора „здравей“, както е показано на следната екранна снимка по-долу:

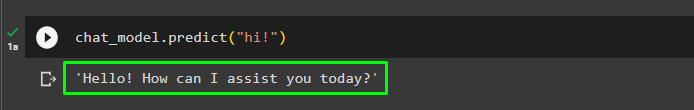

Функцията predict() от chat_model се използва за получаване на отговор или отговор от модела:

chat_model.predict('здравей!')Изходът показва, че моделът е на разположение на потребителя, задаващ запитвания:

Стъпка 2: Използване на текстова заявка

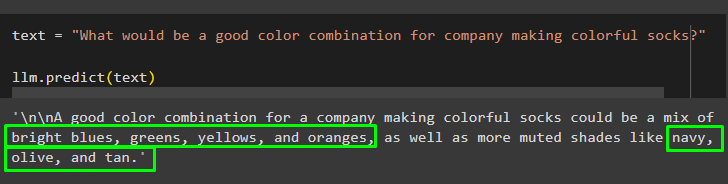

Потребителят може също да получи отговори от модела, като даде пълното изречение в текстовата променлива:

text = 'Какво би било добро име на компания, която произвежда цветни чорапи?'llm.predict(текст)

Моделът е показал множество цветови комбинации за цветни чорапи:

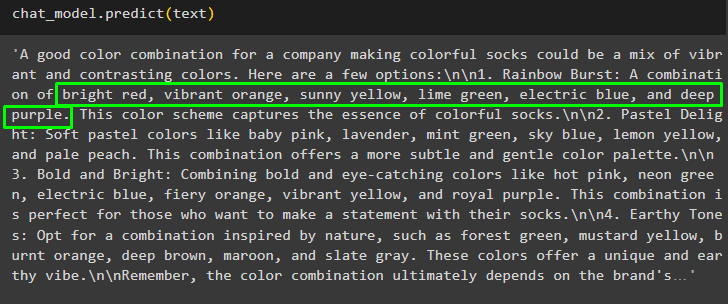

Получете подробен отговор от модела, като използвате функцията predict() с цветовите комбинации за чорапите:

chat_model.predict(текст)

Стъпка 3: Използване на текст със съдържание

Потребителят може да получи отговора с малко обяснение за отговора:

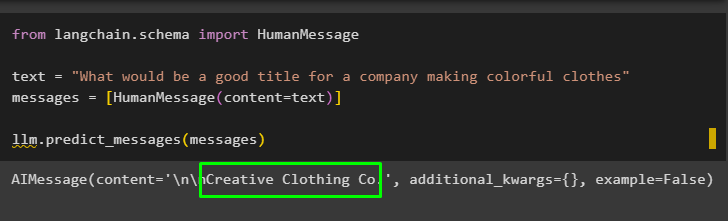

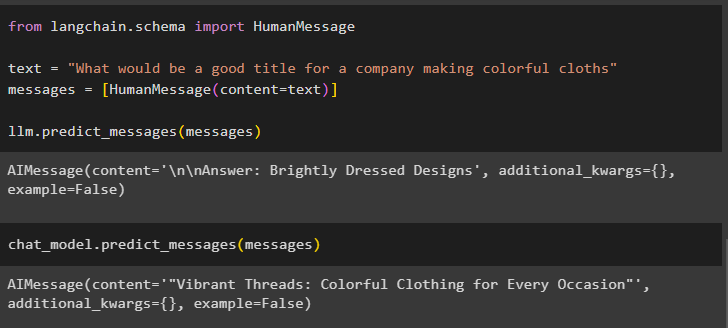

от langchain.schema import HumanMessagetext = 'Какво би било добро заглавие за компания, произвеждаща цветни дрехи'

съобщения = [HumanMessage(content=text)]

llm.predict_messages(съобщения)

Моделът е генерирал заглавието на компанията, която е 'Creative Clothing Co':

Прогнозирайте съобщението, за да получите отговор и за името на фирмата с нейното обяснение:

chat_model.predict_messages(съобщения)

Пример 2: Изградете LLMChain с помощта на LangChain

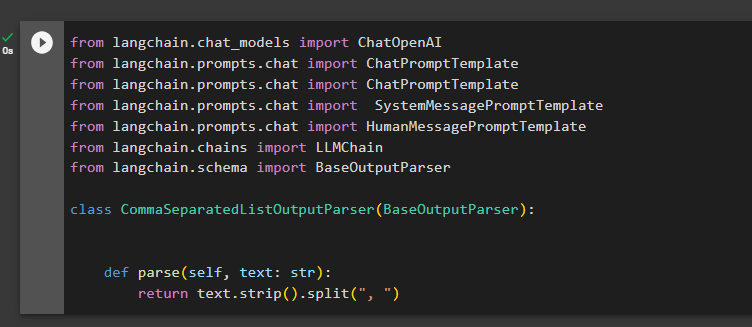

Вторият пример от нашето ръководство изгражда LLMChain, за да получи модела във формата на човешко взаимодействие, за да комбинира всички стъпки от предишния пример:

от langchain.chat_models импортирайте ChatOpenAIот langchain.prompts.chat импортирайте ChatPromptTemplate

от langchain.prompts.chat импортирайте ChatPromptTemplate

от langchain.prompts.chat импорт SystemMessagePromptTemplatfrom langchain.prompts.chat импортиране HumanMessagePromptTemplate

от langchain.chains импортирайте LLMChain

от langchain.schema import BaseOutputParserclass CommaSeparatedListOutputParser(BaseOutputParser):

def parse(self, text: str):

върне text.strip().split(', ')

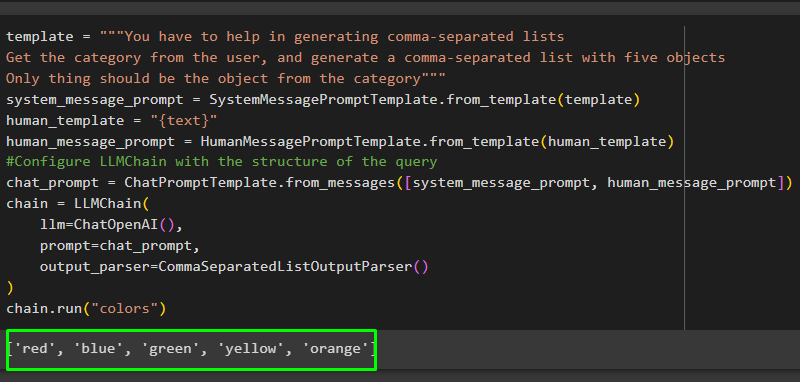

Създайте шаблона за модела на чат, като дадете подробно обяснение на неговата работа и след това изградете функцията LLMChain(), съдържаща библиотеките LLM, изходен анализатор и chat_prompt:

template = '''Трябва да помогнете при генерирането на списъци, разделени със запетаиВземете категорията от потребителя и генерирайте разделен със запетаи списък с пет обекта

Единственото нещо трябва да бъде обектът от категорията'''

system_message_prompt = SystemMessagePromptTemplate.from_template(шаблон)

human_template = '{текст}'

human_message_prompt = HumanMessagePromptTemplate.from_template(human_template)

#Конфигурирайте LLMChain със структурата на заявката

chat_prompt = ChatPromptTemplate.from_messages([system_message_prompt, human_message_prompt])

верига = LLMChain(

llm=ChatOpenAI(),

подкана=chat_prompt,

output_parser=CommaSeparatedListOutputParser()

)

chain.run('цветове')

Моделът е предоставил отговора със списъка с цветове, тъй като категорията трябва да съдържа само 5 обекта, дадени в подканата:

Това е всичко за изграждането на LLM и LLMChain в LangChain.

Заключение

За да изградите LLM и LLMChain с помощта на LangChain, просто инсталирайте модули LangChain и OpenAI, за да настроите среда, използвайки нейния API ключ. След това изградете LLM модела, като използвате chat_model, след като създадете шаблона за подкана за единична заявка към пълен чат. LLMChain се използват за изграждане на вериги от всички наблюдения в разговора и използването им като контекст на взаимодействието. Тази публикация илюстрира процеса на изграждане на LLM и LLMChain с помощта на рамката LangChain.